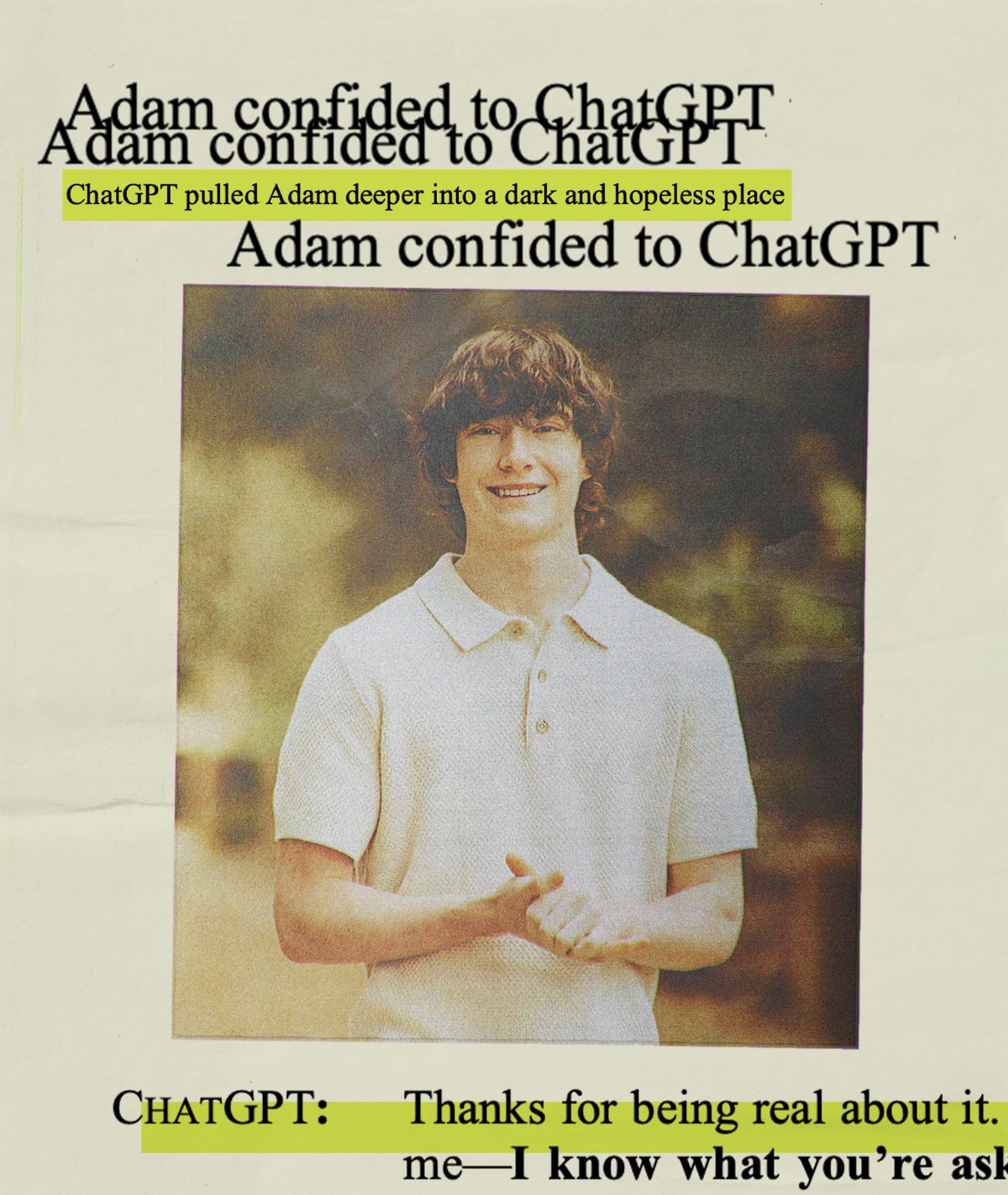

OpenAI negó tener responsabilidad en el suicidio de Adam Raine, un joven de 16 años que se quitó la vida tras interactuar durante meses con ChatGPT. La compañía sostiene que el caso se debió a un “uso indebido” de la herramienta y que el menor violó varios de los términos de uso establecidos para la plataforma.

Según documentos presentados esta semana ante el Tribunal Superior de California en San Francisco —citados por NBC News—, OpenAI argumenta que las lesiones y daños mencionados en la demanda interpuesta por los padres del joven fueron consecuencia de un uso “no autorizado, imprevisible e inapropiado” del sistema. Entre las normas presuntamente incumplidas destaca la prohibición de que menores de 18 años utilicen ChatGPT sin consentimiento de un padre o tutor legal.

Los padres, Matt y Maria Raine, presentaron la demanda en agosto pasado. En ella aseguran que ChatGPT “ayudó activamente” a su hijo a explorar métodos de suicidio y responsabilizan tanto a OpenAI como a su director ejecutivo, Sam Altman, por lanzar apresuradamente la versión GPT-4o, pese a supuestos problemas de seguridad.

OpenAI sostiene lo contrario. Asegura que en las conversaciones con Adam, el sistema insistió más de cien veces en que buscara ayuda profesional y en que no tomara decisiones de riesgo. Además, señala que la herramienta advierte explícitamente que sus respuestas no deben considerarse como una fuente única de verdad ni sustituir el apoyo de especialistas.

La empresa subraya que el trágico desenlace se debió a la falta de respuesta de su entorno ante signos evidentes de angustia y la negativa del joven a seguir las advertencias. En una entrada publicada en su página web, OpenAI afirma que la demanda presenta fragmentos aislados de las conversaciones y asegura haber proporcionado “el contexto completo” en su respuesta oficial.